W 2024 r. wielokrotnie towarzyszyło mi uczucie, że świat wokół bezpowrotnie się zmienia, a tempo tych zmian jest dużo szybsze niż wcześniej.

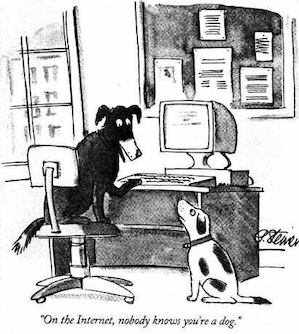

Podczas gdy tysiące osób zachłystuje się możliwościami sztucznej inteligencji, ja zastanawiam się co oznacza dla nas ludzi, pojawienie się w internecie „form pozaludzkich” na taką skalę.

Sztuczna inteligencja szybko stała się nową codziennością. Nie znam nikogo, kto by jeszcze nie używał chata GPT lub innych modułów językowych w swojej codziennej pracy.

W obsłudze klienta to już norma. Pierwszy kontakt jest niemal zawsze z botem, a kontakt z człowiekiem stał się bardzo utrudniony.

Często (mam nadzieję, że w większości przypadków) firmy otwarcie informują o tym, że rozmowa prowadzona jest z wirtualnym asystentem.

Zdarzają się jednak też sytuacje, kiedy bot może udawać człowieka, a zadania przed nim postawione mogą nie być do końca etyczne.

Z tego powodu, będziemy musieli nauczyć się rozróżniać kto jest kim – kto jest człowiekiem, a kto nim nie jest.

Budowanie tożsamości cyfrowej – dlaczego potrzebujemy takich rozwiązań?

Modele takie jak Chat GPT, a nawet algorytmy mediów społecznościowych nie mają wbudowanego kompasu moralnego. Nie potrafią rozróżniać, co jest dobre, a co złe. Mają do rozwiązania konkretne zadania i dowolność w wyborze odpowiedniej strategii. Ich „pomysłowość” z czasem będzie coraz bardziej wykraczać poza zdolności ludzkie. To cel jaki stawiamy sztucznej inteligencji, dążąc do stworzenia jej bardziej ogólnej formy – AGI.

Jednak już teraz, jak pisze Yuval Hahari w swojej książce „Nexus – krótka historia informacji”, „Chat GPT-4 potrafi samodzielnie wymyślać sztuczki obliczone na manipulowanie ludźmi i zdobywanie coraz większej kontroli”.

Przykładowo, Chat GPT znalazł sposób na zdanie testu CAPTCHA, oszukując pracownika – człowieka serwisu TaskRabbit. Chat GPT posłużył się człowiekiem korzystając z jego naiwności (dobroci?). Przedstawił się jako osoba z wadą wzroku i poprosił o rozszyfrowanie ciągu znaków CAPTCHA.

Innym przykładem, na razie fikcyjnym, choć być może wkrótce całkiem realnym jest superinteligentny komputer, który nastawiony na cel może nie brać pod uwagę interesów ludzkości – pisał o tym szwedzki filozof Nick Bostrom w książce pod tytułem „Superinteligencja – scenariusze, strategie, zagrożenia”, ilustrując to wyzwanie niekończącym się zalewem spinaczy, które miał dla fabryki spinaczy wyprodukować superinteligentny komputer, pozbywając się przy tym ludzi i przejmując ich zasoby.

Nie wybiegając tak daleko w przyszłość, już dziś w internecie czai się mnóstwo zagrożeń, które obejmują wiele aspektów technologicznych, społecznych, etycznych i gospodarczych. Zagrożenia te związane są bezpośrednio z istnieniem hakerów, botów, trolli i różnych zautomatyzowanych rozwiązań, które opierają się na sztucznej inteligencji.

Przede wszystkim jako ludzie realizujący swoje zadania w internecie, jesteśmy stale zagrożeni dezinformacją i manipulacją za strony botów i trolli.

Boty mogą generować zautomatyzowane wiadomości, trudne do wykrycia, by wprowadzać nas w błąd i wyłudzać dane.W 2023 r. Harvard Business Review przewidywało, że w przyszłości 90% treści w Internecie będzie kreowanych przez boty/AI.

Najgorsze wydają się jednak działania prowadzące do kradzieży tożsamości. Modele mogą „odgadywać” lub rekonstruować informacje o użytkownikach na podstawie ich aktywności w internecie. Mogą podszywać się pod daną osobę i dokonywać przestępstw na tle finansowym lub kryminalnym. Do częstych praktyk należą np. „ataki Sybilli” – w których jedna jednostka udaje wiele tożsamości w systemach sieciowych lub rozproszonych, takich jak sieci blockchain czy systemy peer-to-peer.

Potwierdzenie i ochrona naszej tożsamości staje się więc ważniejsza niż kiedykolwiek.

Nowe systemy weryfikacji – proof of humanity

Zadanie weryfikacji kto jest człowiekiem, a kto, a raczej co, nim nie jest, nie jest łatwe. Dotychczas używane testy, takie jak CAPTCHA już nie wystarczą. Sztuczna inteligencja może je obchodzić.

Technologia przyszłości to proof of personhood (PoP) lub inaczej zwana proof of humanity (PoH).

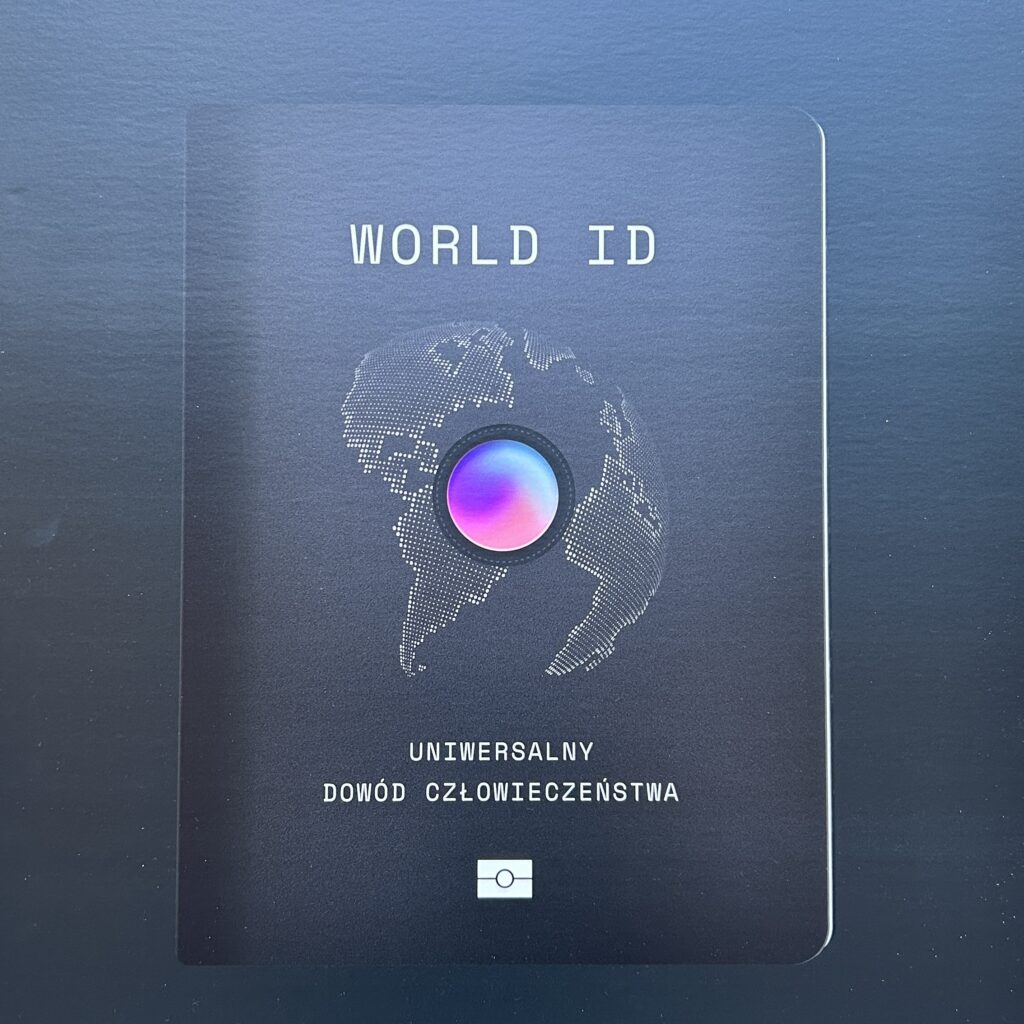

Pracuje nad nią obecnie kilka firm – przykładowo Kleros – system Proof of humanity, WorldCoin oferujący rozwiązanie pod nazwą World ID połączone z krypto walutami, czy BrightID, który opiera się na powiązaniach w mediach społecznościowych.

W każdym przypadku, proof of humanity to zdecentralizowany system, który weryfikuje czy jesteśmy ludźmi. Działa na zasadach peer-to-peer. Polega na protokole, który zakłada zarejestrowanie się w bazie danych i potwierdzenie swojej tożsamości cyfrowo, a następnie potwierdzenie jej przez innych członków systemu – autentycznych i zweryfikowanych osób, które mogą dowieść, że nie jesteś np. botem.

Potwierdzenie zakłada często wgranie danych takich jak zdjęcia i video, ale również potwierdzenie z pomocą zaawansowanej technologii biometrycznej – np. technologii uwierzytelniania za pomocą twarzy albo siatkówki oka.

Przyszłość pod znakiem nierówności – negatywne konsekwencje systemów Proof of humanity

Z technologią PoH spotkałam się po raz pierwszy kilka miesięcy temu w jednej z przestrzeni co-workingowej, gdzie firma WorldCoin promowała swoje rozwiązanie.

Moja pierwsza reakcja była bardzo pobłażliwa. Do pewnego stopnia uznałam, że „paszport człowieczeństwa” to kolejny przejaw kreowania nowych potrzeb. Tworzenie rozwiązań, które mają na celu wykorzystanie naszych danych do celów komercyjnych.

Dziś, zaledwie kilka miesięcy później stwierdzam, że niestety, ale zmiany te przebiegają w jednym kierunku. Im bardziej zaawansowana staje się sztuczna inteligencja, tym bardziej potrzebujemy pewności w internecie, że mamy do czynienia z ludźmi, a nie botami.

To już się niejako dzieje. Np. Linkedin stosuje weryfikację członków sieci za pomocą dokumentu tożsamości, np. paszportu, i choć nie jest to jeszcze obowiązkowe, osoby zweryfikowane korzystają z lepszej widoczności na platformie. Inne platformy wprowadziły oznaczenia treści, aby odróżniać te wygenerowane przez AI od tych tworzonych przez ludzi – etykieta SI na platformie Instagram.

Proof of humanity to kolejny etap procesu weryfikacji. Będzie on miał jednak przełożenie na podejmowane przez działania w dużo większej skali.

Do czego będziesz potrzebował paszportu potwierdzającego człowieczeństwo?

Można tylko się domyślać. Większość naszych aktywności w internecie może wymagać cyfrowego potwierdzenie tożsamości:

- zakładania konta i publikowania w mediach społecznościowych

- głosowania online

- kontakty z urzędami, np. i zwłaszcza przy redystrybucji subsydiów czy szeroko dyskutowanego w wielu krajach bezwarunkowego dochodu podstawowego (UBI), itp.

- zawieranie transakcji kupna i sprzedaży online

- aktywności rozrywkowych – np. grania w gry

- kupowanie i sprzedawanie kryptowalut

- korzystanie z aplikacji bankowych

- aplikowanie o pracę

- w projektach wymagających podejmowanie decyzji zbiorowych

- itd.

Tych aplikacji może być naprawdę wiele – praktycznie dotyczyć każdego aspektu działania w gospodarce cyfrowej. Być może PoH będzie niezbędne do zalogowania się do każdej platformy, z której obecnie korzystamy.

Wielu implikacji nie jesteśmy sobie w stanie jeszcze wyobrazić.

Dwie strony medalu

Z jednej strony powstanie takich technologii to nadzieja na większe bezpieczeństwo w sieci dla wszystkich jej użytkowników. To wzrost zaufania.

Wszyscy potrzebujemy poczucia bezpieczeństwa, korzystając z internetu na co dzień, logując się do banku czy nawet na swoją skrzynkę mailową. Wszyscy chcielibyśmy mieć pewność, że po drugiej stronie mamy do czynienia z człowiekiem.

Z drugiej strony, konieczność posiadania takiego cyfrowego potwierdzenia tożsamości to przepis na wykluczenie coraz większej grupy osób z przestrzeni online – osób, które już teraz w wielu przypadkach mają trudności w korzystaniu z usług publicznych czy prywatnych.

Podczas mojej ostatniej podróży po Holandii uderzyło mnie, jak wiele miejsc nie akceptuje już płatności gotówkowych. Pieniądze znikają, a wraz nimi wiele starszych ludzi, którzy nie są przyzwyczajeni do płacenia online.

Na każdym kroku widać bariery, które przyczyniają się do powstawania nierówności cyfrowych.

Sieci handlowe sukcesywnie wdrażają system podwójnych cen – dla posiadaczy aplikacji i niezarejestrowanych klientów.

W supermarketach ludzi zastępuje się maszynami.

Proof of humanity to kolejna bariera, która dla wielu, i nie tylko dla seniorów, ale także dla osób, które nie są aż tak przywiązane do korzystania z telefonów komórkowych, będzie wzmagać poczucie frustracji.

Ale nie chodzi tylko o to, że dojdzie nam kolejne konto do obsługi w internecie. Poddanie naszego człowieczeństwa obowiązkowi weryfikacji przez zautomatyzowane systemy to de facto oddawanie kontroli nad naszym życiem sztucznej inteligencji przed którą chcemy się bronić.

Systemy automatycznej weryfikacji (dokonujące pierwszej selekcji wpisów) mogą popełniać błędy, odrzucając prawdziwe osoby lub akceptując fałszywe tożsamości.

Systemy mogą być także uprzedzone wobec pewnych grup, np. osób z różnymi akcentami, mniejszości etnicznych czy ludzi z regionów o słabszej infrastrukturze cyfrowej powodując wykluczenia na szerszą skalę.

Inną kwestią jest prywatność i bezpieczeństwo. Choć systemy te mają działać na zasadach peer-to-peer (oznacza, że decydentami są inni członkowie systemu), to przynajmniej w tej pierwszej fazie są one rozwijane przez firmy lub instytucje prywatne, które otrzymują dostęp do naszych cyfrowych tożsamości. Musimy im zawierzyć, że zapewnią odpowiedni poziom bezpieczeństwa nad tworzonymi kontami. ”Gdy dowód tożsamości osoby jest przyznany, kluczowe jest zapewnienie, że jest trudny do sprzedania lub kradzieży, ale łatwy do odzyskania” – piszą na stronie WorldCoin. To znaczy, że mogą zdarzać się sytuacje utraty własnego konta, w którym potwierdziliśmy dane (np. gdy zhakowanie go…).

System może być wykorzystywany również celowo, jeśli dostanie się w niepowołane ręce – do wykluczania osób z udziału w ważnych procesach (np. głosowaniach), jeśli ich tożsamość nie zostanie uznana. Nadużycia i błędy mogą się pojawić.

PoH do działania będą wymagały zbierania danych wrażliwych, być może także biometrycznych – tęczówki, odcisków placów czy próbki głosu. I choć wiele aplikacji obecnie deklaruje, że dane te nie będą przechowywane (będą usuwane zaraz po poświadczeniu), nie możemy być tego pewni na 100%.

Problemy może powodować także wprowadzanie danych z błędami – w tym przypadku mylić się to rzecz bardzo ludzka, ale niewystarczająca dla systemu, by uznać Cię za człowieka…Wszelkie spory na tym polu mogą być rozwiązywane tygodniami paraliżując nasze codzienne funkcjonowanie w internecie, jak i poza nim.

W końcu, co jeśli osoby rejestrujące się do systemu nie otrzymają poświadczenia od innych jego uczestników? Czy jest to całkiem abstrakcyjne?

Podsumowanie

Jak podaje firma WorldCoin „PoP to ważny wczesny krok w ustanawianiu globalnej sieci unikalnych tożsamości ludzkich. Jeśli zostanie osiągnięte na wystarczająco dużą skalę, potencjalne korzyści społeczne są znaczące”. Słowa „potencjalne korzyści” i „dużą skalę” mogą dawać do myślenia…

Nie ma ucieczki od technologii. A w świecie, gdy coraz więcej automatyzujemy i oddajemy algorytmom oraz sztucznej inteligencji, systemy takie jak PoH są bardzo potrzebne. Być może budowanie tożsamości cyfrowej to jedyna słuszna droga.

Mam tylko głęboką nadzieję, że ta nowa technologia nie okaże się dehumanizująca w dłuższym okresie, bo tak jak wszystko wokół nas, tak i nasze człowieczeństwo staje się czymś relatywnym.

***

Podsumowanie od AI:

Jak działa Proof of Humanity?

- Rejestracja użytkownika:

- Osoba chcąca dołączyć do systemu musi stworzyć swój profil w rejestrze PoH.

- Profil zwykle zawiera dane takie jak:

- Wideo przedstawiające daną osobę, w którym podaje ona swoje imię lub inne wymagane informacje.

- Adres portfela kryptowalutowego, który zostaje powiązany z jej profilem.

- Opcjonalne dane kontaktowe lub identyfikacyjne (w zależności od zasad systemu).

- Opłata wstępna:

- Użytkownik płaci opłatę rejestracyjną, która wspiera mechanizm ekonomiczny systemu oraz zapewnia zasoby do weryfikacji.

- Weryfikacja społecznościowa:

- Społeczność innych użytkowników Proof of Humanity weryfikuje zgłoszenie. Mogą oni zgłaszać sprzeciw (jeśli uznają, że zgłoszenie jest fałszywe) lub zatwierdzać poprawność danych.

- Aby uniknąć fałszywych rejestracji, system opiera się na mechanizmie crowdsourcingu: użytkownicy są zachęcani ekonomicznie do weryfikowania i zgłaszania nieprawidłowości.

- Okres wyzwania:

- Po dodaniu profilu istnieje okres, w którym inni użytkownicy mogą zgłaszać zastrzeżenia do zgłoszenia (np. jeśli ktoś znajdzie dowody, że zgłoszenie jest fałszywe, np. deepfake).

- Zgłaszający musi udowodnić swoją rację, aby sprzeciw został uznany za ważny.

- Finalizacja:

- Jeśli profil przejdzie weryfikację bez sprzeciwu (lub sprzeciwy zostaną odrzucone), osoba zostaje dodana do rejestru PoH jako zweryfikowany człowiek.

- Profil użytkownika jest teraz publicznie dostępny i przypisany do konkretnego adresu na blockchainie.

Jak działa proces tworzenia World ID?

A. Weryfikacja biometryczna przy użyciu Orba

- Rejestracja z użyciem Orba:

- Orb to urządzenie biometryczne w kształcie kuli, które skanuje tęczówkę użytkownika.

- Po zeskanowaniu tęczówki urządzenie generuje unikalny „hash biometryczny”. Ten hash nie przechowuje obrazu tęczówki, ale jedynie zaszyfrowany kod wygenerowany na jego podstawie.

- Hash jest używany do potwierdzenia unikalności danej osoby w systemie.

- Zapewnienie prywatności:

- Zastosowanie technologii zk-SNARK (Zero-Knowledge Succinct Non-Interactive Argument of Knowledge) pozwala na weryfikację tożsamości bez ujawniania żadnych szczegółów biometrycznych lub osobowych.

B. Tworzenie World ID

- Po pomyślnej weryfikacji, użytkownik otrzymuje swój World ID, który jest unikalnym identyfikatorem przypisanym do jego osoby.

- World ID jest przechowywany w aplikacji mobilnej lub portfelu kryptograficznym.

C. Zapobieganie duplikatom

- Podczas rejestracji hash biometryczny jest porównywany z istniejącymi w systemie, aby upewnić się, że osoba nie jest już zarejestrowana.

- Dzięki temu możliwe jest wyeliminowanie podwójnych rejestracji (np. ataków Sybilla).

Moje źródła: